Meta 發(fā)布 Llama 4 系列模型,參數(shù)高達(dá)2萬億

Meta 對 DeepSeek 的回應(yīng)來了:Llama 4 發(fā)布,包括具備長上下文處理能力的 Scout 和 Maverick 模型,且擁有 2 萬億參數(shù)的龐然大物 Behemoth 也即將推出。

2025 年 1 月,隨著 DeepSeek R1 在研究人員和企業(yè)中迅速普及,據(jù)報(bào)道 Meta 在得知這個(gè)新的 R1 模型的訓(xùn)練成本只是許多其他領(lǐng)先模型的一小部分,卻僅花費(fèi)幾百萬美元(相當(dāng)于 Meta 給其一些 AI 團(tuán)隊(duì)負(fù)責(zé)人的薪酬)就超越了這些模型時(shí),陷入了恐慌狀態(tài)。

在那之前,Meta 的整個(gè)生成式 AI 戰(zhàn)略一直基于以其“Llama”品牌發(fā)布一流的開源模型,供研究人員和公司自由使用并在此基礎(chǔ)上進(jìn)行開發(fā)。至少,對于那些月用戶數(shù)少于 7 億的用戶來說是這樣,若月用戶數(shù)超過這個(gè)數(shù)字,則需要聯(lián)系 Meta 獲取特殊的付費(fèi)許可條款。

然而,DeepSeek R1 在預(yù)算少得多的情況下卻展現(xiàn)出驚人的出色性能,據(jù)稱這震動(dòng)了 Meta 的領(lǐng)導(dǎo)層,并促使其進(jìn)行某種反思。就在 2024 年 12 月,也就是一個(gè)月前,Meta 剛剛發(fā)布了上一版本的 Llama 3.3,但在當(dāng)時(shí)它顯得有些過時(shí)。

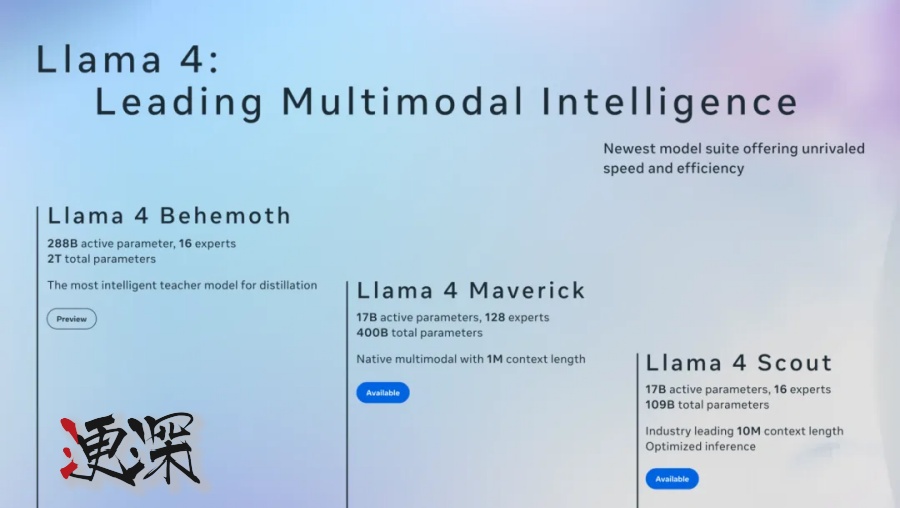

現(xiàn)在我們知道了那次反思的成果:當(dāng)?shù)貢r(shí)間 4 月 5 日,Meta 創(chuàng)始人兼 CEO 扎克伯格在他的 Instagram 賬號上宣布推出新的 Llama 4 系列模型,其中兩款——擁有 4000 億參數(shù)的 Llama 4 Maverick 和擁有 1090 億參數(shù)的 Llama 4 Scout——現(xiàn)已可供開發(fā)者在 llama.com 和 AI 代碼共享社區(qū) Hugging Face 上下載、使用或進(jìn)行微調(diào)。

同樣在 4 月 5 日,擁有 2 萬億參數(shù)的大型模型 Llama 4 Behemoth 也發(fā)布了預(yù)覽版,不過 Meta 的博客文章稱該模型仍在訓(xùn)練中,并未透露其可能的發(fā)布時(shí)間。需要注意的是,參數(shù)指的是控制模型行為的設(shè)置,一般來說參數(shù)越多意味著模型在各方面更強(qiáng)大、更復(fù)雜。

這些模型的一個(gè)主要特點(diǎn)是它們都是多模態(tài)的,經(jīng)過針對文本、視頻和圖像的訓(xùn)練,因此能夠接收和生成這些內(nèi)容。

另一個(gè)特點(diǎn)是它們擁有較長的上下文窗口——Llama 4 Maverick 為 100 萬個(gè) tokens,Llama 4 Scout 為 1000 萬個(gè) tokens——分別相當(dāng)于大約 1500 頁和 15000 頁的文本內(nèi)容,并且模型在一次輸入/輸出交互中就能處理這些內(nèi)容。這意味著理論上用戶可以上傳或粘貼多達(dá) 7500 頁的文本內(nèi)容,并從 Llama 4 Scout 獲得同樣多的回復(fù),這對于醫(yī)學(xué)、科學(xué)、工程、數(shù)學(xué)、文學(xué)等信息密集型領(lǐng)域來說非常實(shí)用。

據(jù)了解,這三個(gè)模型都采用了“專家混合(MoE)”架構(gòu)方法,這種方法在 OpenAI 和 Mistral 早期發(fā)布的模型中得到了推廣,本質(zhì)上是將多個(gè)專門處理不同任務(wù)、主題和媒體格式的較小模型(即“專家”模型)組合成一個(gè)更大的統(tǒng)一模型。據(jù)說每個(gè) Llama 4 模型都是 128 個(gè)不同專家模型的混合體,并且運(yùn)行效率更高,因?yàn)樵谔幚砻總€(gè) tokens 時(shí),只需特定任務(wù)所需的專家模型加上一個(gè)“共享”專家模型,而無需讓整個(gè)模型對每個(gè) tokens 都進(jìn)行處理。

雖然所有參數(shù)都存儲在內(nèi)存中,但在運(yùn)行這些模型時(shí),只有總參數(shù)的一個(gè)子集被激活。這通過降低模型運(yùn)行成本和延遲提高了推理效率——Llama 4 Maverick 可以在單個(gè)英偉達(dá) H100 DGX 主機(jī)上運(yùn)行,不僅便于部署,也可以通過分布式推理實(shí)現(xiàn)最高效率。

Llama 4 Scout 和 Llama 4 Maverick 現(xiàn)已向公眾開放,可供自行部署,不過 Meta 尚未公布其官方基礎(chǔ)設(shè)施的托管 API 或定價(jià)等級。相反,Meta 專注于通過開放下載以及與 WhatsApp、Messenger、Instagram 和網(wǎng)頁版的元 AI 進(jìn)行集成來進(jìn)行分發(fā)。

Meta 估計(jì),Llama 4 Maverick 的推理成本為每 100 萬個(gè) tokens 0.19 美元至 0.49 美元(輸入和輸出比例為 3:1)。根據(jù)社區(qū)基準(zhǔn)測試,這使得它比像 GPT-4o 這樣的專有模型便宜得多,據(jù)估計(jì) GPT-4o 的成本為每 100 萬個(gè) tokens 4.38 美元。

Llama 4 的三個(gè)模型尤其是 Maverick 和 Behemoth,都被設(shè)計(jì)用于推理、編碼和逐步解決問題,不過它們似乎沒有表現(xiàn)出像 OpenAI 的“o”系列或 DeepSeek R1 等專門推理模型那樣的思維鏈。

相反,它們似乎旨在更直接地與“經(jīng)典”的非推理大語言模型和多模態(tài)模型競爭,比如 OpenAI 的 GPT-4o 和 DeepSeek 的 V3。但是,Llama 4 Behemoth 除外,它似乎確實(shí)對 DeepSeek R1 構(gòu)成了威脅。

此外,對于 Llama 4,Meta 構(gòu)建了專注于增強(qiáng)推理能力的定制訓(xùn)練后流程,例如:

- 在有監(jiān)督的微調(diào)過程中,去除超過 50% 的“簡單”提示。

- 采用不斷增加難度提示的持續(xù)強(qiáng)化學(xué)習(xí)循環(huán)。

- 使用“k 次嘗試通過”評估和課程采樣來加強(qiáng)在數(shù)學(xué)、邏輯和編碼方面的性能。

- 采用一種名為 MetaP 的新技術(shù),讓工程師可以在模型上調(diào)整超參數(shù)(如每層的學(xué)習(xí)率),并將其應(yīng)用于其他不同規(guī)模和 tokens 類型的模型,同時(shí)保持模型預(yù)期的行為。

MetaP 可被用于在一個(gè)模型上設(shè)置超參數(shù),然后應(yīng)用于許多其他類型的模型,從而提高訓(xùn)練效率。這樣可以節(jié)省大量的時(shí)間和金錢,從而可以在較小的模型上進(jìn)行實(shí)驗(yàn)。

在訓(xùn)練像 Behemoth 這樣的大型模型時(shí),這一點(diǎn)尤其關(guān)鍵,Behemoth 使用 32000 個(gè) GPU 和 FP8 精度,在超過 30 萬億個(gè) tokens 上實(shí)現(xiàn)了每個(gè) GPU 390 TFLOPs 的運(yùn)算能力,其訓(xùn)練數(shù)據(jù)是 Llama 3 的兩倍多。換句話說:研究人員可以大致告訴模型他們希望它如何運(yùn)行,并將這種設(shè)置應(yīng)用于不同規(guī)模的模型,以及不同形式的媒體上。

在 Instagram 上的發(fā)布視頻中,扎克伯格表示 Meta 的“目標(biāo)是打造世界領(lǐng)先的 AI,將其開源,并讓所有人都能使用,從而使全世界的人都受益…… 我早就說過,我認(rèn)為開源 AI 將成為領(lǐng)先的模型,而隨著 Llama 4 的推出,這正在成為現(xiàn)實(shí)。”

Meta 的博客文章稱 Llama 4 Scout“是同類中世界上最好的多模態(tài)模型,比所有上一代 Llama 模型都更強(qiáng)大”。這些的確都是非常強(qiáng)大的模型,與同參數(shù)規(guī)模的其他模型相比,它們處于領(lǐng)先地位,但不一定創(chuàng)造了新的性能紀(jì)錄。盡管如此,Meta 還是熱衷于宣揚(yáng) Llama 4 系列模型的“超越性”。

使用參數(shù)最高的基準(zhǔn)測試模型 Llama 4 Behemoth,并將其與 DeepSeek R1 最初發(fā)布的 R1-32B 模型圖表以及 OpenAI o1 模型進(jìn)行比較之后發(fā)現(xiàn),雖然 DeepSeek R1 和 OpenAI o1 在幾個(gè)指標(biāo)上領(lǐng)先于 Behemoth,但 Llama 4 Behemoth 仍然具有很強(qiáng)的競爭力,在其同類推理排行榜上處于領(lǐng)先或接近領(lǐng)先的位置。

Meta 還通過引入 Llama Guard、Prompt Guard 和 CyberSecEval 等工具來強(qiáng)調(diào)模型的一致性和安全性,以幫助開發(fā)者檢測不安全的輸入/輸出或?qū)剐蕴崾荆?shí)施生成式攻擊性代理測試(GOAT)來進(jìn)行自動(dòng)化的紅隊(duì)測試。

該公司還聲稱 Llama 4 在“政治偏見”方面有顯著改善,并表示“(領(lǐng)先的大語言模型)在有爭議的政治和社會(huì)話題上歷來傾向于左派觀點(diǎn)”,而 Llama 4 在迎合右派觀點(diǎn)方面表現(xiàn)得更好……”這與扎克伯格在 2024 年選舉后對美國總統(tǒng)特朗普及其政黨的支持相一致。

此外,Meta 的 Llama 4 模型在多模態(tài)和推理任務(wù)中融合了效率、開放性和高端性能。

隨著 Scout 和 Maverick 現(xiàn)已向公眾開放,以及 Behemoth 作為最先進(jìn)的教師模型進(jìn)行了預(yù)覽,Llama 生態(tài)系統(tǒng)有望成為 OpenAI、Anthropic、DeepSeek 和谷歌等公司頂級專有模型的有力開源替代品。