阿西莫夫 機器人 三大定律,還適用于今天的 AI 嗎?

1942 年,偉大的科幻作家艾薩克·阿西莫夫(Isaac Asimov)在他的短篇小說《轉(zhuǎn)圈圈》(Runaround)中首次提出了“機器人三定律”。之后,這些定律因為他的短篇小說集《我,機器人》而廣為流傳。

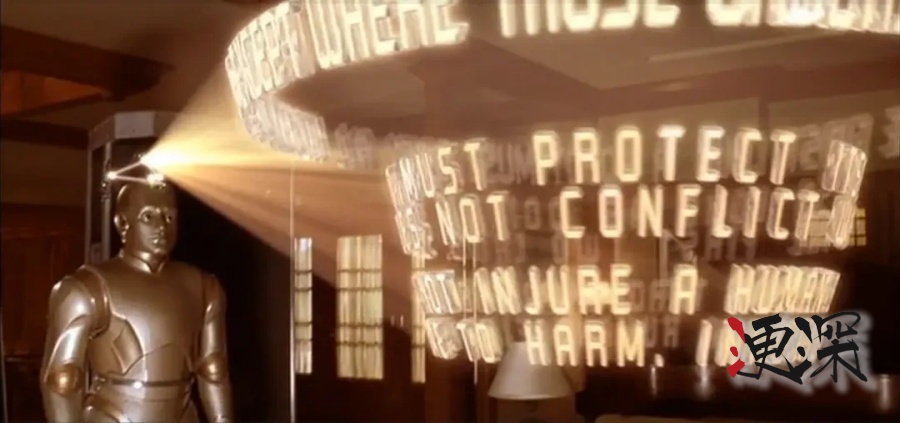

1、機器人不得傷害人類,也不得因不作為而使人類受到傷害。

2、機器人必須服從人類給予它的命令,除非這些命令與第一法則相沖突。

3、機器人必須保護自己的存在,只要這種保護不與第一或第二定律相沖突。

機器人三定律的影響是如此之大,它不但構(gòu)成了阿西莫夫所有機器人科幻小說的組織原則,甚至滲透進了之后幾乎所有的機器人科幻小說,以及所有引用它的書籍、電影、游戲等流行文化中。

例如,1966 年的短篇小說《薩姆的密碼》中的“阿森尼翁機器人的三大法則”,就是對機器人三定律的改編;1999 年的電影《2001 太空漫游》中,羅賓·威廉姆斯(Robin Williams)飾演的機器人安德魯,通過其頭部的投影儀全息展示了機器人三定律;至于威爾·史密斯(Will Smith)主演的《我,機器人》,更是花費整部電影的時間詳細討論了這三大定律。

安德魯向新主人馬丁一家講解機器人三定律|圖片來源:medium

人們甚至發(fā)展出了一門專門研究人與機器人關(guān)系的學科——機器人倫理學。這是一門以人類為責任主體,研究如何開發(fā)和應用機器人的倫理學。追蹤其源頭,就是阿西莫夫的三定律。

在阿西莫夫生活的年代,人工智能還處于相當早期的階段。論文《神經(jīng)活動中內(nèi)在思想的邏輯演算》(A Logical Calculus of Ideas Immanent in Nervous Activity)被視為人工智能學科的奠基石,這篇論文在機器人三定律發(fā)表后一年公布;直到 1956 年,達特茅斯人工智能夏季研討會召開,人工智能作為一門學科,才真正創(chuàng)立。

也就是說,機器人三定律是在一種小說家社會實驗的語境下誕生的。

如果借鑒原教旨主義的概念的話,機器人三定律可以算是機器人倫理學的原教旨主義。今天當然還有眾多阿西莫夫的信徒,但是人工智能的現(xiàn)實環(huán)境已與當初大不相同。

這讓人不禁十分好奇,在 AI 如此火熱的當下,作為原教旨的機器人三定律,還能指導今天人與 AI 的關(guān)系嗎?

01 作為創(chuàng)作工具的機器人三定律

很難脫離機器人三定律的創(chuàng)作背景討論它的意義。阿西莫夫在 1975 年接受 Sy Bourgin 采訪時提到,他創(chuàng)作機器人三定律的動機,是為了擺脫此前科幻小說《弗蘭肯斯坦》式的套路——也就是機器人殺害主人,創(chuàng)造物最終會摧毀其創(chuàng)造者。

因此,從本質(zhì)上來說,機器人三定律不是一個全面的道德框架,它們是為故事服務的創(chuàng)作工具。它們被創(chuàng)作出來的目的,就是為了突出一種不確定性、一種沖突的潛在可能,以探討人與 AI 之間的灰色邊界。

一個有力的證據(jù)就是,在阿西莫夫的每一個故事中,機器人三定律都失敗了。阿西莫夫故意模棱兩可地創(chuàng)造了這 3 個定律,以便制造困境,讓角色和觀眾都面臨道德困境。

一旦運用到真實世界,這 3 條被稱為“定律”的東西就會轟然崩塌。例如,巡航導彈、軍用無人機就是違反第一和第三定律的機器人。它們由計算機控制,只會做它們被編程去做的事情。如果它們被編程去傷害人類,它們就會傷害人類。

從語言學的角度來說,機器人三定律也是無法成立的。因為這 3 項定律是用英語寫成的,英語是一種自然語言,本質(zhì)上是模棱兩可的,可以有多種解釋。因此,將機器人三定律編碼成精確的、機器可讀的指令是不切實際的。

來自武漢大學哲學系的克里斯·斯托克斯(Chris Stokes)更是在他的論文《Why the three laws of robotics do not work》中逐一解釋了為什么機器人三定律是行不通的:

1、第一條法則失敗是因為語言上的歧義,以及因為過于復雜的倫理問題,這些問題太復雜,無法簡單地用是或否來回答。

2、第二定律失敗,因為要求有感知的生物保持奴隸狀態(tài)的定律,本質(zhì)上是不道德的。

3、第三定律失敗,因為它導致永久的社會分層,這個定律體系中內(nèi)置了大量的潛在剝削。

正如 iRobot 的創(chuàng)始人羅德尼·布魯克斯(Rodney Brooks)所說:“人們問我,我們的機器人是否遵循阿西莫夫的法則。它們不遵循的原因很簡單——我無法將阿西莫夫的法則植入它們體內(nèi)!”

iRobot 的名字正是來自于阿西莫夫的短篇小說集《I,Robot》。這家公司最出名的兩個產(chǎn)品,是掃地機器人和軍用武裝機器人。

02 人類的恐懼

2022 年湯加火山的爆發(fā)曾經(jīng)引發(fā)過一場關(guān)于“無夏之年”的恐慌。歷史上,每逢無夏之年,都會引起氣溫驟降,進而導致全球性的災難。

上一個無夏之年發(fā)生在 1816 年,印尼的坦博拉火山爆發(fā)。積聚的火山灰讓全球氣溫至少下降了 0.4 度,氣候反常引起了全球范圍內(nèi)的饑荒、傷寒和暴亂。

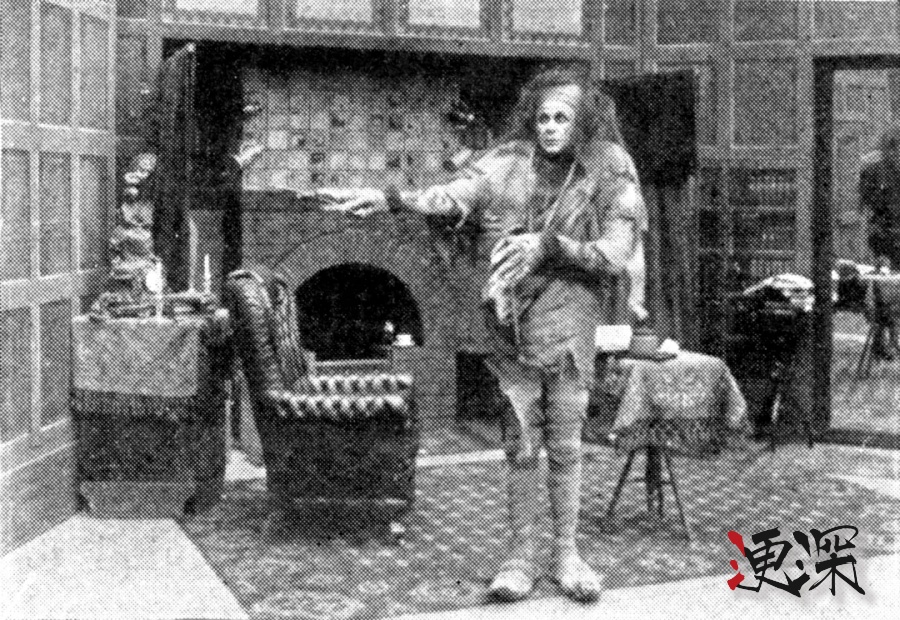

那個“潮濕、不適、連綿降雨”的夏天,迫使新婚的雪萊夫婦滯留在了拜倫在日內(nèi)瓦湖畔的別墅。為了打發(fā)時間,拜倫提出了一場寫作比賽,看誰能寫出最恐怖的故事。雪萊的妻子—瑪麗,在那段時間里寫出了《弗蘭肯斯坦》。

1910 年,愛迪生工作室制作了《弗蘭肯斯坦》的第一個電影改編版|圖片來源:Wikipedia

今天我們記得《弗蘭肯斯坦》當然是因為它是世界上第一部科幻小說。但是請注意,瑪麗參加的可是一個恐怖故事比賽,《弗蘭肯斯坦》有什么恐怖的呢?

《弗蘭肯斯坦》講述的是生物學家弗蘭肯斯坦,利用人類尸體拼湊出了一個怪物。在被人類排斥的過程中,怪物對弗蘭肯斯坦產(chǎn)生了怨恨,殺死了他的眾多親友。弗蘭肯斯坦最后也因追捕怪物而死。

德國科布倫茨大學的烏爾里克·巴塞爾梅斯(Ulrike Barthelmess)和烏爾里希·福爾巴赫(Ulrich Furbach)認為,《弗蘭肯斯坦》反映出的是人類數(shù)千年內(nèi)心的恐懼,即人類不能像上帝那樣創(chuàng)造生物,任何試圖這么做的人都會受到懲罰。

另一個例子是 16 世紀的猶太神話里魔像(Golem)的傳說。在其中的一個版本里,拉比利用粘土創(chuàng)造出了魔像,以保護猶太人社區(qū)。拉比承諾在每次安息日前關(guān)閉魔像以讓他休息。但有一次拉比忘記了,于是魔像變成了一個屠殺社區(qū)的怪物。

布拉格的瑪哈拉爾與魔像,1899|圖片作者:Mikolá? Ale?

正如美國電影理論家布萊恩·亨德森 (Brian Henderson) 所說,重要的是講述神話的年代,而不是神話所講述的年代。換句話說,神話當然是虛構(gòu)的,但是當時的人們,出于何種動機、何種背景,講述這樣的神話,才是真正重要的。

進一步將“創(chuàng)造生物”這個概念擴展開來,這種對“創(chuàng)造物”的恐懼,或許也可以理解成一種對技術(shù)的恐懼。希臘神話里,因為將火傳播于人間,普羅米修斯受到上帝懲罰,每日受老鷹啄食肝臟之苦。在這個故事中,“火”即技術(shù)。有一種學術(shù)觀點認為,正是因為掌握了火,吃上了熟食,人類才不用耗費大量的能量消化生食,才得以進化出了發(fā)達的大腦。與此同時,正是利用了其他動物對火的恐懼,人類才得以在夜間抵御野獸。

巧合的是,《弗蘭肯斯坦》的副標題恰好是“另一個普羅米修斯的故事”。

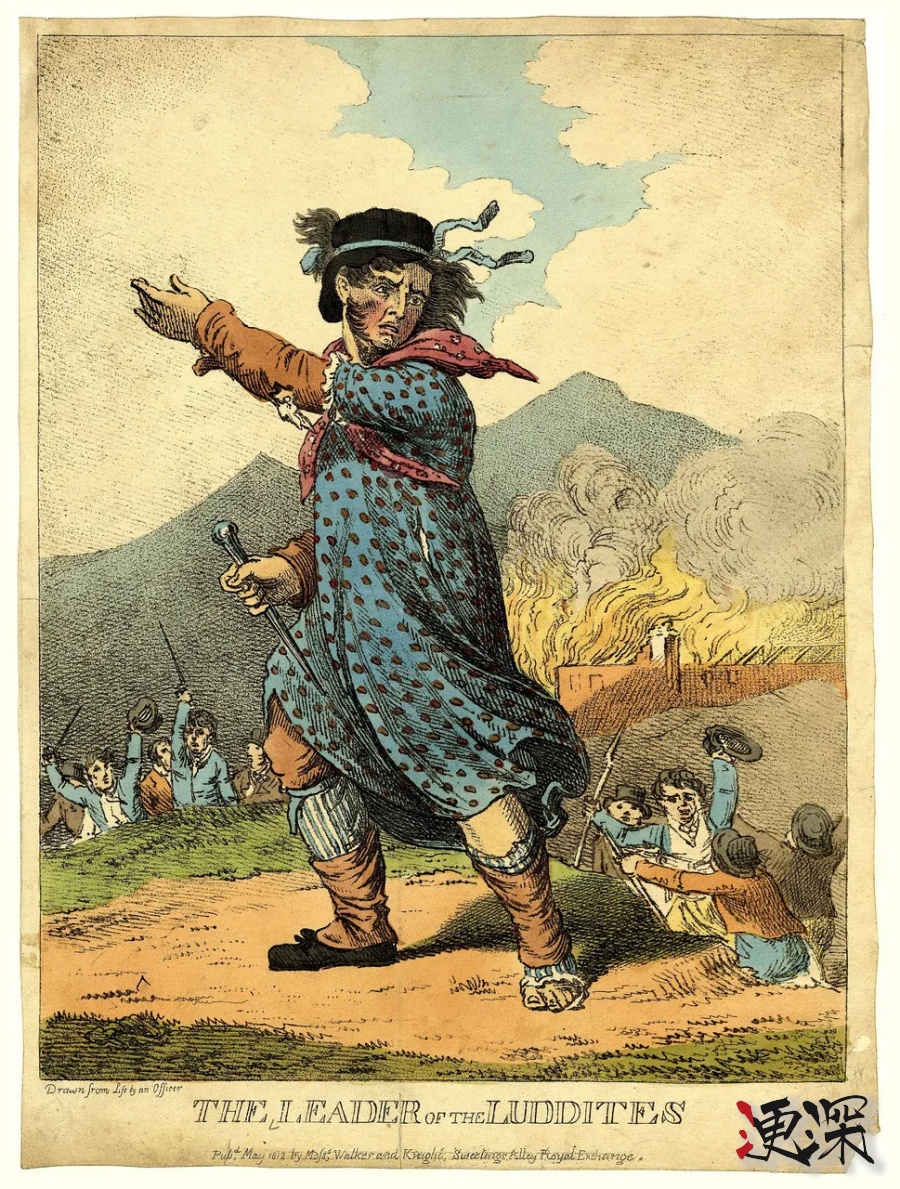

在近現(xiàn)代,人類對技術(shù)的恐怖更加常見。例如在工業(yè)革命時期的英國,人們就對機器改變世界的能力產(chǎn)生了極大的恐懼,開始了一場專門摧毀紡織機的運動。這場運動的后果是如此嚴重,以至于議會立法將拆除機器定為死罪。其中一個被稱為“盧德分子”的團體,甚至和英國軍隊爆發(fā)了沖突。在今天,“盧德分子”依然用來描述一切新科技的反對者,他們被稱為“新盧德分子”。

盧德運動領(lǐng)袖,1812|圖片來源:Wikipedia

當我們帶著恐懼的視角審視機器人三定律的時候,就可以看到其中充滿了對機器人的嚴防死守,以及背后幽微深長的恐懼心理。

與此同時,它天然將機器人置于了完全服從的奴隸地位(機器人 robot 源自捷克語 robota,意思正是“強迫勞動”)。這會成為一個問題,取決于我們看待機器人的視角。當我們把機器人視為“工具”時,這是合理的;但是當我們把機器人視為有感知的生物、甚至連它們自己也這么覺得時,那這兩個“種族”就是天然矛盾的,沖突遲早會發(fā)生。

三江學院副教授、作家劉勃在描述魏晉南北朝時期,北方游牧民族和漢民族之間的民族仇殺時是這么解釋的:“當經(jīng)濟優(yōu)勢和政治優(yōu)勢屬于同一方的時候,通過建立威權(quán)體系,勉強可以維持社會的正常運轉(zhuǎn),一旦兩個優(yōu)勢分屬雙方,社會的撕裂也就難以避免。”

這個問題放在今天的世界仍然適用。

而眼下,AI 正在做我們認為我們最擅長的所有事情。在某些情況下,它要比人類表現(xiàn)得好得多。在肉眼可見的將來,它也會越來越強大。

03 現(xiàn)實中的機器人法則

遺憾的是,目前現(xiàn)實世界中并沒有一部通行的法律實行。機器人、AI、自動駕駛這些近似的概念相互混雜,有所交叉又各有不同;針對特定國家、地區(qū)制訂的建議、指導方針、道德框架可以說是一鍋大雜燴。

在國家層面,歐美國家是最積極的立法推動者。

歐盟 2024 年的 AI 法案是截至目前最嚴格的監(jiān)管法案。它禁止將 AI 用于社會評分目的(利用個人數(shù)據(jù)個性化推薦就是社會評分的范疇),限制 AI 在犯罪畫像中的使用,并要求對 AI 生成的內(nèi)容進行標簽。對被歸類為對健康、安全或基本權(quán)利構(gòu)成高風險的 AI 開發(fā)者,歐盟 AI 法案制定了一系列特殊要求。

美國國會還沒有提出全面的關(guān)于 AI 的法案,但在州一級,硅谷所在的加州最為積極。其州長最近簽署了 17 項人工智能法案,包括從保護表演者的數(shù)字形象到禁止與選舉相關(guān)的深度偽造。加拿大正試圖采取與歐盟類似的方法,其執(zhí)政黨提議已經(jīng)提議了《人工智能和數(shù)據(jù)法案》(AIDA)。

相對于機器人三定律對人工智能的強烈限制,這些法案的共同點在于限制的主體是 AI 的創(chuàng)造者、使用者,也即人類本身。

歐美國家對于 AI 的相關(guān)限制法案同樣心口不一|圖片來源:caravel law

與此同時,歐美的監(jiān)管遭到了大型科技公司的反對。OpenAI CEO Sam Altman 就稱,如果監(jiān)管過于嚴格,OpenAI 可能會離開歐洲;扎克伯格也在 8 月發(fā)表了一篇評論,將歐盟的監(jiān)管方法描述為“復雜且不連貫”,警告這可能會破壞一個“一代人一次”的創(chuàng)新機會,以及利用 AI 的“經(jīng)濟增長機會”的機會。

在加拿大,亞馬遜和微軟的高管公開譴責了 AIDA,稱其含糊不清且負擔沉重;Meta 表示,它可能會推遲在加拿大推出某些人工智能產(chǎn)品。

而在一些非西方國家,態(tài)度則截然不同。他們優(yōu)先考慮的不是監(jiān)管,而是吸引大型科技公司的投資。印度是最典型的例子,它擁有中美以外最大的互聯(lián)網(wǎng)產(chǎn)業(yè)。目前,印度政府已投入 12 億美元用于名為“印度 AI”的倡議。其總理莫迪 9 月在一次圓桌會議上與硅谷 CEO 們會面時,他敦促他們“在印度與世界共同開發(fā)、共同設計和共同生產(chǎn)”。

目前印度在人工智能領(lǐng)域尚沒有監(jiān)管。而科技巨頭方面,OpenAI 承諾通過大量投資開發(fā)者社區(qū)來支持印度 AI 倡議;亞馬遜已撥出數(shù)億美元支持印度人工智能初創(chuàng)企業(yè),并與印度理工學院(IIT)簽署了多年人工智能合作協(xié)議;微軟最近也承諾在印度投資 30 億美元,用于人工智能培訓、云和人工智能基礎設施。

可以說,科技巨頭在一定層面上極大地影響了全球政府的政策。他們既是 AI 的創(chuàng)造者,也是最大的利益相關(guān)者。面對 AI 這樣一種超越國界的國界的工具,各國可以制定自己的法律,但也必須就一些基本規(guī)則達成共識。畢竟,如果牌桌上連規(guī)則都沒有的話,這局游戲是必然要崩盤的。

04 AI 自己的建議

那么,機器或者 AI 自己,是如何看待這個問題的?

最后,我們詢問了 ChatGPT,該如何完善阿西莫夫的機器人三定律,以下是它的回答:

1. 增強對人類自主性的尊重

阿西莫夫的第一定律強調(diào)了機器人不能傷害人類,或者因不作為而讓人類受到傷害。為了增強 AI 對人類自主性和隱私的尊重,可以增加類似“AI 必須尊重個體的自主選擇和隱私權(quán)”的原則。例如:

新建議:“AI 必須尊重人類的自由意志、隱私權(quán)和選擇,避免對人類的決策產(chǎn)生不正當影響。”

2. 多層次的責任分配

阿西莫夫的定律中沒有明確如何界定 AI 錯誤行為的責任,導致可能出現(xiàn)責任歸屬不清的問題。在現(xiàn)代社會,AI 系統(tǒng)的決策可能涉及復雜的道德和法律層面。因此,應增加條款明確責任歸屬,避免“責任空白”。

新建議:“在 AI 行為引發(fā)的問題上,應明確 AI 使用者、開發(fā)者、監(jiān)管機構(gòu)等多方的責任,并對其行為進行透明化追蹤。”

3. 對 AI 的自我意識和自我約束的控制

阿西莫夫的三定律基于機器人沒有自我意識的假設,但隨著 AI 技術(shù)的發(fā)展,越來越多的 AI 系統(tǒng)具備了某種程度的自我學習和適應能力。為了防止 AI 做出不符合人類利益的決策,建議在 AI 系統(tǒng)中嵌入“自我約束”的機制。

新建議:“AI 系統(tǒng)必須具備自我約束機制,確保其行為始終符合人類的倫理標準,并具有撤銷決策或行為的能力。”

4. 強化道德與倫理框架

隨著 AI 在社會各個層面的深入應用,其決策不僅關(guān)乎技術(shù)層面的合理性,還涉及倫理問題。例如,AI 在醫(yī)療、司法等敏感領(lǐng)域的決策需要更加謹慎。因此,可以建議在三定律中明確規(guī)定 AI 系統(tǒng)必須在處理決策時考慮倫理和社會價值觀。

新建議:“AI 應始終遵循公認的道德和倫理標準,并在處理復雜決策時優(yōu)先考慮公平、正義和人類福祉。”

5. 可調(diào)節(jié)性與透明度

現(xiàn)代 AI 系統(tǒng)往往是黑箱式的,難以理解其決策過程。為了增強人類對 AI 的信任,需要規(guī)定 AI 系統(tǒng)應當具備透明度,確保其行為和決策可以被理解、審查和調(diào)整。

新建議:“AI 的決策過程必須透明,且可由合適的主體審查和調(diào)整,以確保其行為符合社會規(guī)范和人類利益。”

6. 限制 AI 的目標設定

如果 AI 的目標設定不當,它可能會采取意外的手段去實現(xiàn)目標,導致對人類的潛在傷害。因此,AI 的目標必須在設計階段就加以嚴格限制,確保其目標始終符合人類長遠利益。

新建議:“AI 的目標設定必須明確受限于人類福祉和社會整體利益,避免執(zhí)行可能導致長期負面后果的目標。”

不用說,上面這些大詞,和當年阿西莫夫創(chuàng)作的“三定律”一樣,很難以代碼形式“植入”進機器的“芯”中。

也許,正是這種難以完全理解和掌握,才更讓 AI 和機器人,更加的讓人們欲罷不能吧。