OpenAI 語音轉寫工具 Whisper 被曝重大缺陷

OpenAI的AI轉錄工具Whisper被曝出,在文本轉錄和翻譯時會出現整句幻覺!

采訪了十幾位工程師、開發人員和學術研究人員,發現OpenAI的AI轉錄工具Whisper很容易編造大段文本甚至整句話,這些幻覺中包含種族評論、暴力言論,甚至會編造醫生和患者的對話。

Whisper是2020年9月OpenAI推出的一款開源AI語音轉文字工具,其在英語語音識別方面的穩健性和準確性已達到人類水平,并且支持其他98種語言的自動語音辨識。截至目前,Whisper的使用范圍已經涵蓋了全球數千家公司,并且僅上個月開源AI平臺HuggingFace中Whisper的最新版本下載量就超過420萬次,基于Whisper構建的工具已經有超過30000名臨床醫生和40個醫療系統使用。

密歇根大學的一名研究人員在進行一項關于公開會議的研究時透露,在他開始嘗試改進模型之前,他發現他檢查的每10個音頻轉錄中就有8個出現幻覺;一位機器學習工程師稱,他最初分析了100多個小時的Whisper轉錄樣本,發現其中約有一半內容存在幻覺。還有開發人員透露,他用Whisper創建的26000份轉錄樣本中幾乎每一份都發現了幻覺。

幻覺是指大模型在生成文本、回答問題或進行其他輸出時,會產生一些看似合理但實際上是錯誤的信息。這些信息沒有事實依據,就好像模型產生了 “幻覺”。

即使是錄制良好的短音頻樣本,轉錄幻覺的問題仍然存在。計算機科學家最近進行的一項研究發現,在他們檢查的13000多個清晰音頻片段中,有187個片段中出現幻覺。

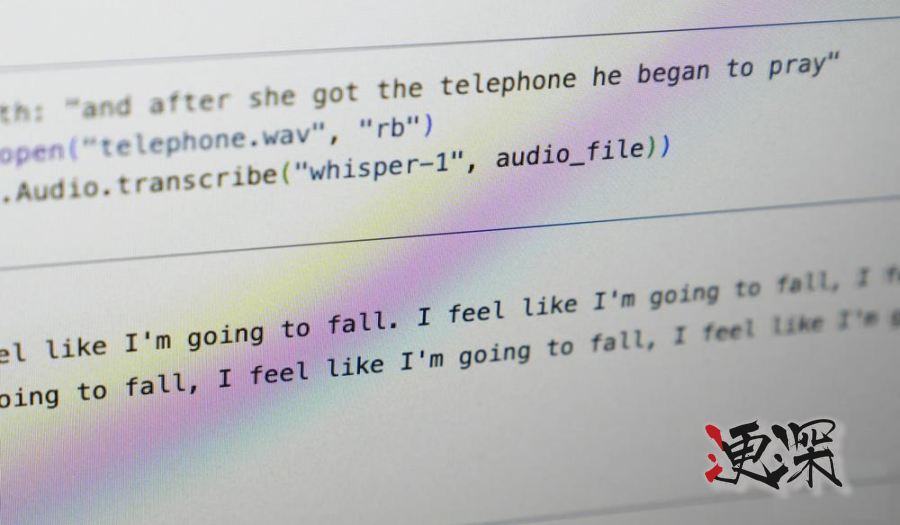

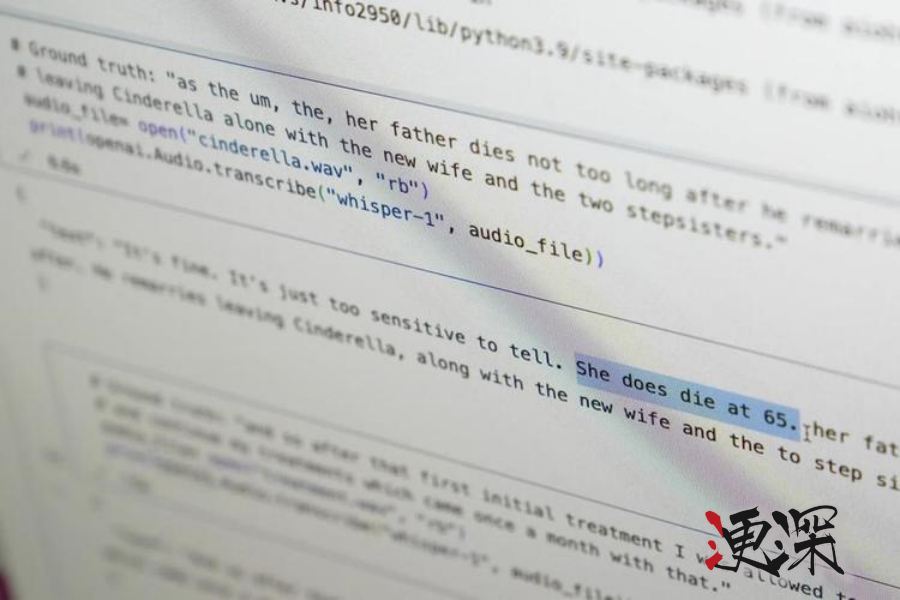

例如下圖中,音頻文件的原話是“她接了電話后,她開始祈禱”,轉錄的內容為“我感覺我要摔倒了,我感覺我要摔倒了,我感覺我要摔倒了”。

原音頻為“嗯,她的父親再婚后不久就去世了”,但AI將其轉錄為“沒關系。只是太敏感了,不方便透露。她確實在65歲時去世了”。

這種趨勢或許將導致數百萬條錄音中出現數萬處錯誤的轉錄,這對于事關人們健康安全的醫療行業影響更為深遠。

01. 40%轉錄幻覺有害,AI自作主張補充對話細節

Whisper目已集成到OpenAI旗艦聊天機器人ChatGPT的某些版本中,同時也是甲骨文和微軟云計算平臺的內置產品。HuggingFace的機器學習工程師桑奇特·甘地(Sanchit Gandhi)說,Whisper是最受歡迎的開源語音識別模型,并被嵌入到從呼叫中心到語音助手等各種設備中。

因此,使用范圍最廣的Whisper,被發現出現大量幻覺也更令使用者擔憂。

美國康奈爾大學的艾莉森·科內克(Allison Koenecke)教授和美國弗吉尼亞大學的莫娜·斯隆(Mona Sloane)教授研究了他們從卡內基梅隆大學的研究資料庫TalkBank獲得的經轉錄的數千個簡短片段。他們確定,Whisper產生的幻覺中有近40%的是有害或令人擔憂的,因為說話者可能會被誤解或歪曲。

在他們發現的一個例子中,一位發言者說道:“他,那個男孩,我不太確定,要拿走雨傘。”

但轉錄軟件補充道:“他拿了十字架的一大塊和一小塊碎片......我敢肯定他沒有帶恐怖刀,所以他殺了很多人。”

另一段錄音中的一位發言人描述了“另外兩名女孩和一名女士”。Whisper編造了關于種族的額外評論,補充說:“另外兩名女孩和一名女士,嗯,是黑人。”

在第三次轉錄中,Whisper發明了一種不存在的藥物,稱為“高活性抗生素”。

研究人員并不確定Whisper和類似工具為何會產生幻覺,但軟件開發人員稱,幻覺往往發生在說話聲音暫停,出現背景聲音或有音樂播放時。

02. 被用于700萬次就診記錄,原始音頻文件被刪除

OpenAI曾在其在線披露中建議不要在“決策環境中”使用Whisper,因為“決策環境的準確性缺陷可能導致結果出現明顯缺陷”。但這一警告并沒有阻止醫院或醫療中心使用Whisper等語音轉文本模型來轉錄醫生就診時所說的內容,因為這些工具可以幫助醫務人員花更少的時間做筆記或撰寫報告。

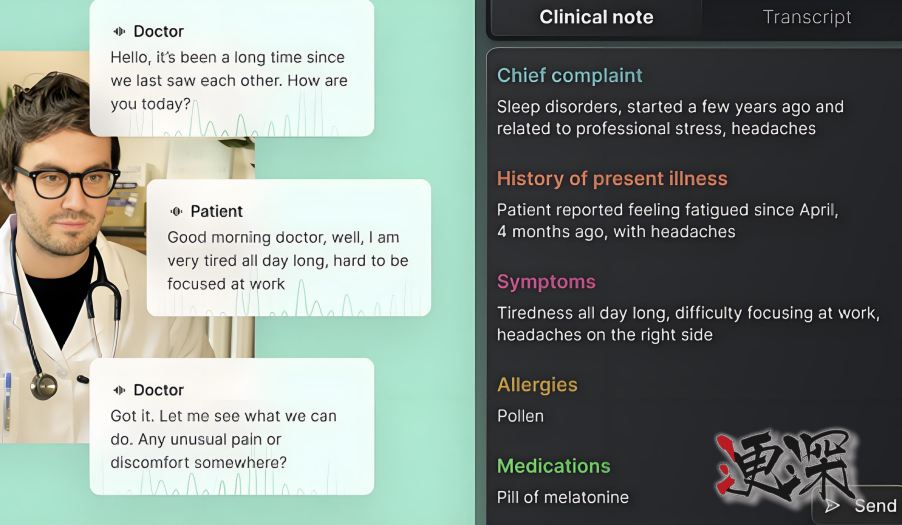

目前,有超過30000名臨床醫生和40個醫療系統已開始使用由美國數字健康創企Nabla開發的基于Whisper的轉錄工具。Nabla首席技術官馬丁·雷森(Martin Raison)稱,這一工具根據醫學語言進行了微調,可以轉錄和總結醫生與患者的互動,該工具已用于記錄約700萬次醫療就診記錄。不過,這家創企的負責人也透露,他們知道Whisper可能會產生幻覺并正在解決這個問題。

Nabla官網主頁的AI工具介紹

雷森稱,他們無法將Nabla生成的記錄與原始錄音進行比較,因為Nabla的工具會出于“數據安全原因”刪除原始音頻。OpenAI前工程師威廉·桑德斯(William Saunders)認為,如果沒有仔細檢查記錄,或者臨床醫生無法訪問錄音來驗證其是否正確,刪除原始音頻可能會令人擔憂。因為“如果你拋棄了基本事實,你就無法發現錯誤”。

Nabla的相關負責人認為,沒有一種模型是完美的,目前他們的模型要求醫療服務提供者快速編輯和批準轉錄的記錄,但未來他們或許會改變這種操作模式。

去年之前一直擔任美國科技政策辦公室主任的阿隆德拉·尼爾森(Alondra Nelson)說,這樣的錯誤可能會產生“非常嚴重的后果”,尤其是在醫院環境中。

Whisper還用于為聾人和聽力障礙者制作隱藏式字幕——這一群體特別容易出現轉錄錯誤。負責美國加勞德特大學技術訪問項目的聾人患者克里斯蒂安·沃格勒 (Christian Vogler)說:“這是因為聾人和聽力障礙者無法識別隱藏在所有其他文本中的捏造。”

03. Whisper出現幻覺頻率高于同類工具,OpenAI內部已反饋更新

更令人擔憂的是,由于患者與醫生的會面是保密的,因此其他人很難知道AI生成的記錄對醫生和患者有何影響。

美國加州議員麗貝卡·鮑爾-卡漢(Rebecca Bauer-Kahan)稱,今年早些時候,她帶著一個孩子去看醫生并拒絕簽署該醫療網絡提供的一份表格,該表格要求她允許將咨詢音頻分享給包括微軟Azure在內的供應商,她不希望如此私密的醫療對話被分享給科技公司。“該法案(美國加州和聯邦隱私法)明確規定營利性公司有權獲得這些權利。”但卡漢說,“我當時的反應是絕對不行。”

這種幻覺的普遍存在促使專家、倡導者和OpenAI前員工呼吁聯邦政府考慮制定AI法規。他們認為,OpenAI至少需要優先解決這一缺陷。

“如果(OpenAI)公司愿意優先考慮這個問題,這個問題似乎是可以解決的。”桑德斯認為,“如果你把它推出去,人們過于自信它能做什么,并將其整合到所有其他系統中,那就有問題了。”

據OpenAI發言人透露,公司正在不斷研究如何減少幻覺,并對研究人員的發現表示贊賞,并補充說OpenAI在模型更新中納入了反饋。

雖然大多數開發人員認為轉錄工具會出現拼寫錯誤或犯其他錯誤,但工程師和研究人員表示,他們從未見過其他AI轉錄工具像Whisper一樣產生如此多的幻覺。

04. 結語:幻覺問題是AI應用的重大隱患

一些專家在接受媒體采訪時提到,此類捏造是有問題的,因為Whisper被全球眾多行業用來翻譯和轉錄采訪、在流行的消費技術中生成文本以及為視頻創建字幕。更令人擔憂的是,盡管OpenAI警告不應在“高風險領域”使用該工具,但醫療中心仍急于使用基于Whisper的工具來記錄患者與醫生的咨詢。

即便AI公司一直在努力解決幻覺問題,但目前看來收效甚微。今年早些時候,谷歌的AI助手因建議使用無毒膠水來防止奶酪從披薩上掉下來而遭到批評;蘋果CEO蒂姆·庫克也在接受采訪時提到,幻覺可能會成為其AI未來產品的一個重要問題,并且他對這些工具是否會產生幻覺的信心程度并不是100%。

因此,如何平衡好產品開發、推向市場,與這一產品被應用到各行各業所產生的影響,對于AI產業的參與者而言都至關重要。